Red Hat, il futuro dell’AI è sempre più ‘open’

La chiave di lettura ‘italiana’ degli annunci del recente Red Hat Summit di Boston. Quattro le principali aree toccate dagli annunci: Linux, AI, Container e Virtualizzazione, IT automation al motto ‘Any model, any accelerator, any cloud’. L’AI entra nei prodotti del vendor

Red Hat Summit 2025: un evento che ogni anno lascia il segno; di successo, capace di chiamare a raccolta una folta comunità di clienti, partner, analisti di mercato, sponsor e stampa.

L’edizione più recente, quella dello scorso maggio a Boston, a cui come G11 Media abbiamo preso parte (qui il reportage), ha visto la partecipazione di quasi 7 mila persone e 70 partner sponsor, provenienti da tutto il mondo. Lo racconta con orgoglio alla stampa locale Rodolfo Falcone, Country Manager, Red Hat Italia, fornendo l’interpretazione italiana dell’evento e commentando gli annunci: “Il connubio Artificial Intelligence e Open Source è sempre più forte ed evidente e Red Hat è una delle pochissime aziende in grado disegnare il futuro in questa direzione”, dice il top manager.

Sul palco della sessione plenaria a Boston, sottolinea Falcone, anche un testimonial italiano come Terna, best user dello stack tecnologico del vendor: “Terna ha raccontato come negli ultimi anni abbia avviato un profondo e moderno processo di trasformazione tecnologica grazie all’utilizzo della tecnologia Red Hat”.

Al motto ‘Any model, any accelerator, any cloud’ all’evento il vendor ha ribadito che 'The future of AI is open': “Sviluppare e gestire progetti di infrastruttura AI, soprattutto di AI generativa, richiede moltissime risorse e l'AI open source, in particolare quella di Red Hat, è un'AI leggera, che non richiede requisiti elevati di hardware ai clienti e non necessita di rifare il datacenter per introdurla nel business.” Rodolfo Falcone, Country Manager, Red Hat Italia

Rodolfo Falcone, Country Manager, Red Hat Italia

Una scelta di campo

Una scelta di campo quella fatta da Red Hat, che di recente proprio in ambito AI, ha acquisito l’azienda Neural Magic: il vendor infatti non propone al mercato una propria offerta di AI generativa, come ChatGPT, ma all’interno dei propri prodotti dà la possibilità di accogliere e gestire l'AI utilizzata dal cliente e di posizionarla all'interno della sua infrastruttura: “Gestire quindi l'AI con Red Hat è molto più semplice, più veloce, più stabile e anche molto più sicuro”, commenta il Country Manager. Un’AI che il vendor vuole portare in tutta la sua dorsale tecnologica. Ricordando anche che oggi Red Hat è in grado di indirizzare le priorità tecnologiche delle aziende clienti – cloud, as a service nelle sue diverse forme, AI, modernizzazione applicativa, sicurezza e virtualizzazione: “quest’ultima, in particolare, in una forma moderna. Oggi, infatti, non si virtualizza più come in passato, lo si fa direttamente sui container”, conclude Falcone.

E’ Giorgio Galli, Manager Solution Architect, Red Hat a tracciare le quattro direzioni tecnologiche indirizzate al Summit e i benefici di business correlati: a partire da Linux, con l’annuncio di Red Hat Enterprise Linux 10; AI con Red Hat AI e non solo; containerizzazione e virtualizzazione intorno alla proposta Red Hat OpenShift; e IT Automation, nel perimetro Red Hat Ansible Automation Platform ed Edge. Giorgio Galli, Manager Solution Architect, Red Hat

Giorgio Galli, Manager Solution Architect, Red Hat

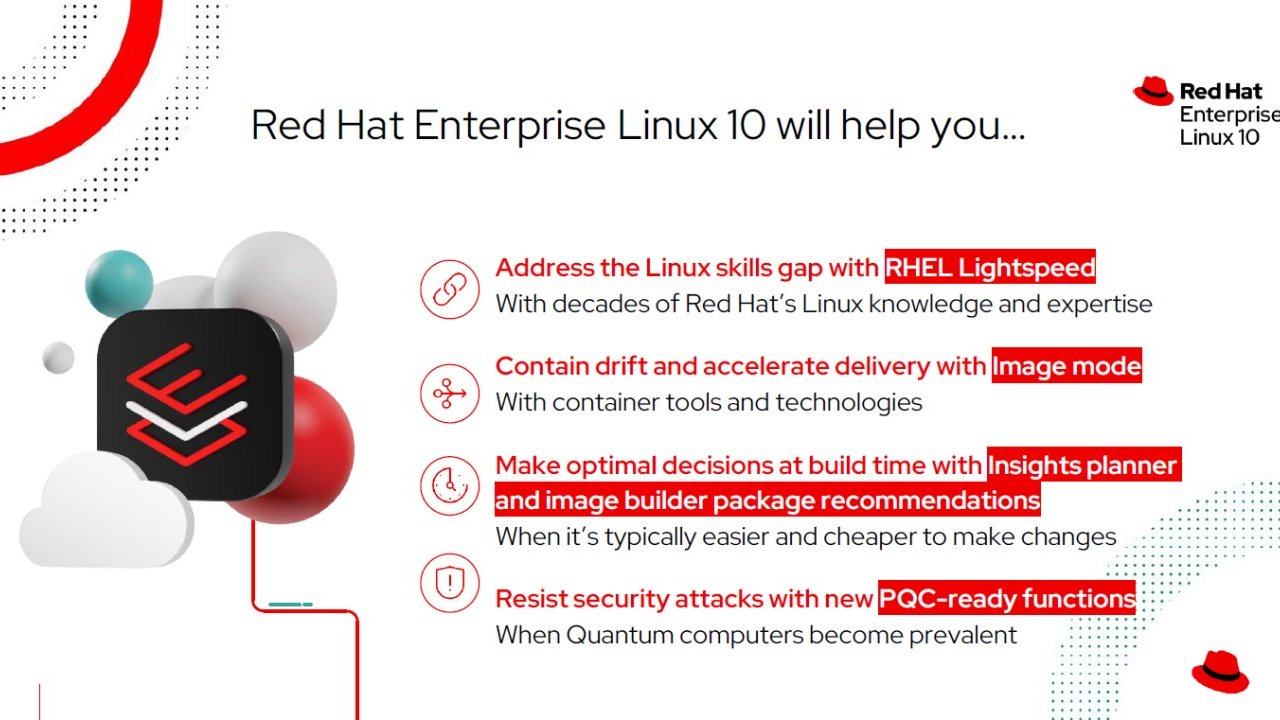

Un sistema operativo ever green: RHEL 10

Red Hat Enterprise Linux nella nuova versione 10 introduce una serie di funzionalità utili per aiutare coloro che si occupano della gestione delle infrastrutture, consentendo di semplificare il day to operation e l’organizzazione: “Oggi la complessità continua ad aumentare dato il numero crescente di sistemi da governare sia on premise sia in cloud e le risorse per farlo sono sempre più limitate. Le nuove funzionalità inserite nel sistema operativo e i rilasci che sono stati fatti in Red Hat Enterprise Linux 10 fanno riferimento a questo go to market, volto a semplificare tutta la progettazione e la gestione sia on prem sia in cloud nelle modalità standard”, introduce Galli. Da parte sua, Red Hat Enterprise Linux, prossimo ai 25 anni di storia, oggi sta passando dalla wave del cloud, foundation sicura per l’innovazione, a una piattaforma per l’era dell’AI in grado di supportare tutti i workload, nella fattispecie tutti i modelli dell’AI – predittivi e generativi -, garantendo sicurezza. Più in dettaglio, Red Hat punta a introdurre l'AI generativa all'interno delle proprie tecnologie. Nello specifico, all’interno della versione 10 di RHEL, è stato quindi introdotto RH Lightspeed, un virtual assistant che, anche a chi non dispone di competenze profonde, permette di interrogarlo e di ricevere una serie di guideline su come gestire determinate situazioni.

Più in dettaglio, Red Hat punta a introdurre l'AI generativa all'interno delle proprie tecnologie. Nello specifico, all’interno della versione 10 di RHEL, è stato quindi introdotto RH Lightspeed, un virtual assistant che, anche a chi non dispone di competenze profonde, permette di interrogarlo e di ricevere una serie di guideline su come gestire determinate situazioni.

È stata inoltre rilasciata una modalità differente di gestire il sistema operativo, denominata Image Mode, ossia in una modalità containerizzata: “Oggi chi rilascia le applicazioni in modalità cloud lo fa mediante applicazioni containerizzate; poiché le applicazioni si appoggiano sul sistema operativo anche questo può essere rilasciato nella stessa modalità, con un evidente vantaggio in termini di operation. Alla modalità tradizionale di rilascio del sistema operativo si è quindi affiancata quella di rilascio e implementazione in modo containerizzato”, spiega Galli. Oltre a ciò, il vendor ha fatto in modo che la gestione del sistema operativo possa essere più semplice anche nella fase di creazione delle immagini.

Da segnalare inoltre che RHEL 10, come dice Galli, è “il primo sistema operativo Linux in grado di ‘resistere’ a eventuali attacchi relativi al quantum computing, mediante l’utilizzo al proprio interno di sistemi di crittografia”.

E in uno scenario hybrid cloud, Red Hat ha rilasciato anche sistemi operativi ottimizzati da utilizzare sugli hyperscaler: “Un lavoro fatto a quattro mani, per cui lo IaaS degli hyperscaler è installato con sopra il nostro sistema operativo ottimizzato per sfruttare al meglio tutto ciò che loro forniscono” - chiarisce Galli. E ancora… la nuova versione prevede il supporto di piattaforme come RISC-V e la possibilità ai clienti con versioni ‘vecchie’ del sistema operativo di ricevere delle fix attraverso il pagamento di un canone: "ancora una volta vogliamo preservare gli investimenti di lungo periodo fatti dai clienti”..

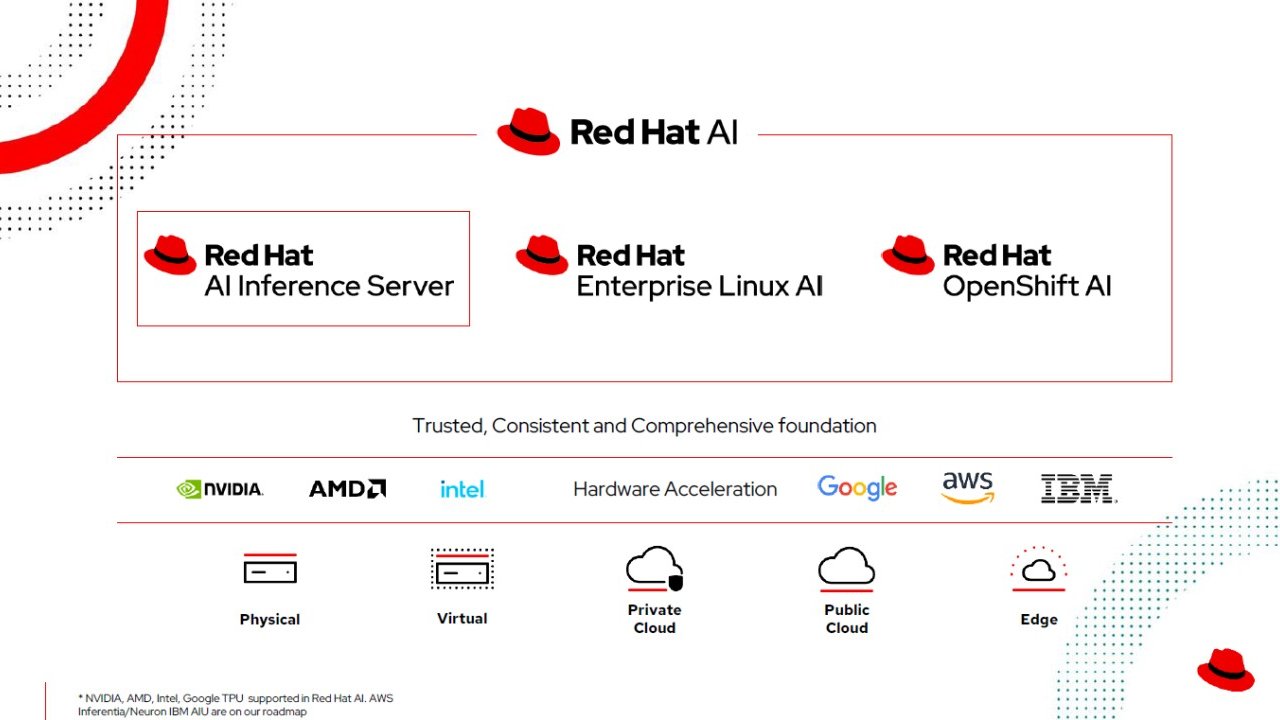

L’AI trasversale a tutto

Al centro dell’evento, come detto, il tema dell’Intelligenza Artificiale: “Red Hat permettere l'utilizzo ibrido delle tecnologie, ovvero on-prem e in cloud, così come delle applicazioni. La stesso vale per i modelli: vogliamo permettere l’utilizzo di un modello indipendentemente dai vari tipi di modelli esistenti, o in cloud sugli hyperscaler oppure su un'infrastruttura on-prem”, dettaglia Galli.

Fondamentale inoltre ottimizzare l'utilizzo delle risorse, facendo sì che i modelli utilizzati sfruttino meno risorse possibili di GPU disponibili o messe a disposizione dagli hyperscaler o sul proprio datacenter. Al momento, ciò è stato reso possibile su due componenti della piattaforma AI – Red Hat AI - ovvero Red Hat Enterprise Linux AI e Red Hat OpenShift AI: “Due ‘flavor’ differenti: con RHEL AI si ha a disposizione una macchina con all'interno alcuni modelli e alcune tecnologie per l’AI generativa in modalità ‘entry-level’. Qualora si debba scalare e le macchine e i modelli diventano più di uno si opta per la tecnologia RH OpenShift che fa uso della containerizzazione ed è in grado di scalare e di ospitare più modelli per gestire anche il ciclo di vita di sviluppo di questi, scalando di conseguenza in termini di capability delle risorse”, dettaglia il manager. Si tratta di tecnologie che sfruttano tutti gli acceleratori oggi disponibili sul mercato.

A tutto ciò è stato aggiunto un nuovo modo di 'andare' sul mercato denominato Red Hat AI Inference Server, cioè la capacità di eseguire un modello in modo efficiente sfruttando l'inferenza. È noto che i modelli LLM hanno dimensioni significative e quando fanno un'interrogazione utilizzano le GPU. L’ideale è far sì che i modelli utilizzino meno GPU possibile. E per far ciò si utilizza una tecnologia, un progetto open source denominato vLLM: “Da parte sua, Red Hat ha acquisito appunto l’azienda Neural Magic che propone una tecnologia, ovvero un progetto al quale partecipano Google, Meta, la stessa Nvdia che la utilizza in modo proprietario sui propri sistemi. Si tratta di un motore in grado di comprimere il modello, semplificandolo, mantenendo la stessa accuratezza delle risposte e consentendo di eseguire quel modello sugli acceleratori utilizzati. In questo modo si rende sostanzialmente agnostico il modello dall'infrastruttura sottostante, ottimizzandolo con la tecnologia vLLM”, prosegue Galli.

Il prodotto specifico è Inference Server la cui tecnologia è stata inclusa anche in RHEL e in OpenShift consentendo quindi anche a queste piattaforme di operare con qualsiasi modello, comprimendolo ed eseguendolo indipendentemente dalla GPU sottostante. Il grande vantaggio per l’utilizzatore è che lui a decidere dove eseguire i modelli in modo ottimizzato.

A tale proposito, alcuni test mostrano come grazie a tale tecnologia si mantiene la stessa accuratezza (97%) ma si sfrutta il 50% in meno delle GPU: “Come Red Hat, crediamo che questa sia la direzione corretta affinché si possano implementare modelli di AI generativa a costi accettabili e in modalità ibrida,” enfatizza Galli.

In questa direzione, all’interno del repository Hugging Face in cui sono presenti molti modelli, Red Hat ha compresso molti di questi e li ha resi disponibili già ottimizzati e validati in modo tale da essere eseguiti attraverso la tecnologia vLLM.

Sempre in tema AI, il vendor ha in corso una serie di iniziative in partnership con vendor come Meta, Google Cloud, AMD, … volte a definire un'architettura di riferimento nell'ambito delle AI: “Progetti per sfruttare al meglio tutte le GPU e orchestrare le richieste, con l’obiettivo di avere n GPU utilizzabili in maniera distribuita”, prosegue Galli.

Come spiega Galli, "l'open source rappresenta quindi un elemento strategico in ambito AI non tanto per la costruzione del modello, ma per l’orchestrazione, l’ottimizzazione e la distribuzione dei carichi al fine di dare vita a un stack architetturale in cui non ci sarà una corrispondenza modello-risposta ma bensì un'orchestrazione dei modelli come è avvenuto con i container".

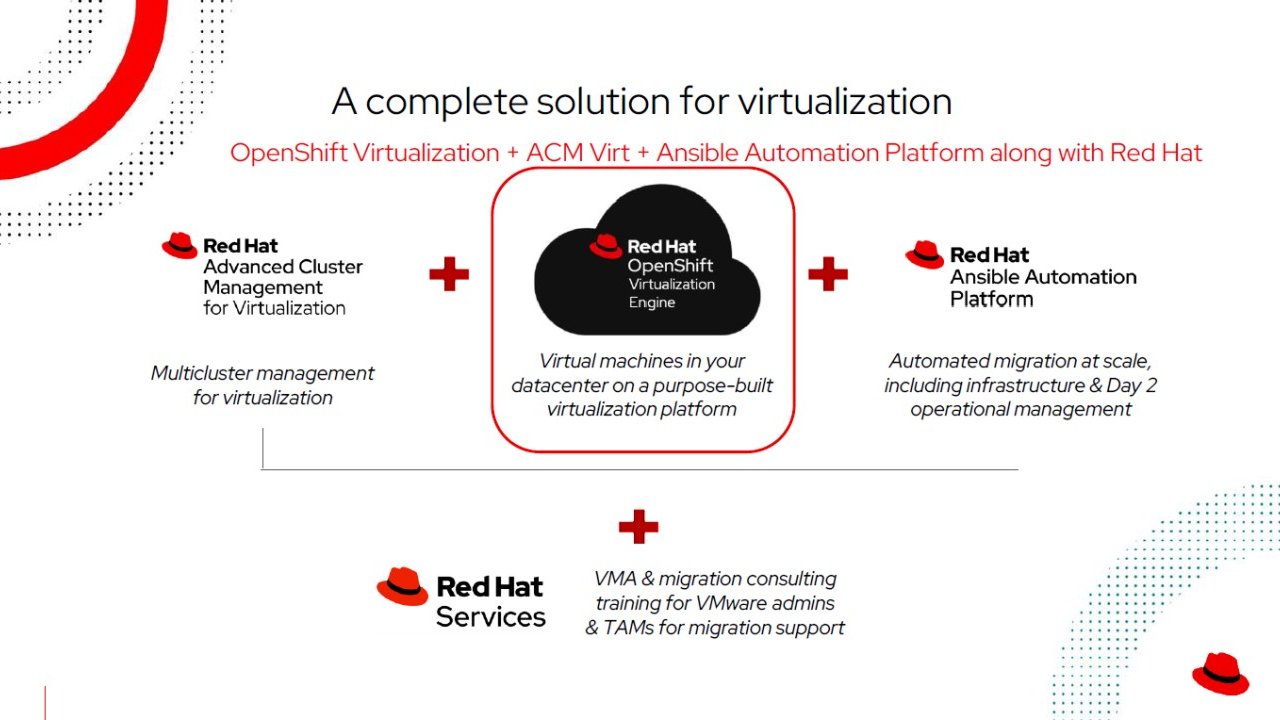

Parola d’ordine: virtualizzare con Red Hat

Molto caldo al Summit anche il tema della virtualizzazione. Una recente survey di Illuminas evidenzia che se oggi il 61% di workload gira su VM tradizionali e il 38% su container, nel prossimo triennio il numero di applicazioni che gireranno sui container passerà al 45%: “Avere quindi come Red Hat la gestione di applicazioni containerizzate e le virtual machine in un’unica piattaforma rappresenta un vantaggio importante”, sottolinea. In questo senso, la tecnologia targata Red Hat, di fatto, è evoluta nel tempo con l’obiettivo di utilizzare RH OpenShift per gestire le macchine virtuali all'interno dei container. Ciò ha dato vita alla tecnologia OpenShift Virtualization Engine, un subset della piattaforma che permette di migrare da un ambiente virtuale a un altro (non container), ovvero a RH OpenShift Virtualization, attraverso un approccio ‘virtual to virtual’, garantendo governance e automazione.

In questo senso, la tecnologia targata Red Hat, di fatto, è evoluta nel tempo con l’obiettivo di utilizzare RH OpenShift per gestire le macchine virtuali all'interno dei container. Ciò ha dato vita alla tecnologia OpenShift Virtualization Engine, un subset della piattaforma che permette di migrare da un ambiente virtuale a un altro (non container), ovvero a RH OpenShift Virtualization, attraverso un approccio ‘virtual to virtual’, garantendo governance e automazione.

sempre in quest'ambito, come spiega Galli, Red Hat sta investendo a livello di ecosistema, non solo per offrire una tecnologia di virtualizzazione come può essere RH OpenShift Virtualization ma per proporre la virtualizzazione integrata con tutto l'ecosistema - VM, backup, availability, …. Rendendo altresì la tecnologia di virtualizzazione non solo disponibile on-prem ma su vari cloud provider: “In questo modo si può disporre di una virtual machine sul proprio data center ma anche spostare la VM su hyperscaler attraverso un ‘move to cloud’ in maniera molto più semplice, lineare ed efficace”.

Oggi, la tecnologia di virtualizzazione Red Hat è disponibile su molti hypervisor presenti sul mercato, come: AWS, Microsoft, Google Cloud, IBM Cloud e Oracle Cloud e prevede non solo RH OpenShift come container ibrido su on-prem o su tutti gli hyperscaler ma anche la virtualizzazione ibrida, on-prem o su tutti gli hyperscaler per completare la capacità del cliente di modernizzare su container o portare su una virtualizzazione moderna le virtual machine che non intende convertire.

Nell’automazione entra l’AI

Quello dell’automazione IT rimane un tema baricentrico nella proposta tecnologica del vendor in uno scenario ibrido in cui convivono on prem e cloud: standardizzare l’IT automation su una piattaforma con Red Hat Ansible è infatti molto importante. Tra le novità in quest’ambito, l’inserimento dell’AI generativa anche in RH Ansible in modo tale da permettere agli utenti, per esempio i gestori dell’infrastruttura non necessariamente degli sviluppatori, di creare automatismi in maniera molto semplice: “Si sta accelerando la creazione di asset di automazione anche su risorse e determinati ambiti con meno competenze o carenti di skill di sviluppo, attraverso Ansible Lighspeed Intelligent Assistant”, spiega Galli.

Da segnalare inoltre nell’ambito dello sviluppo, il rilascio di Red Hat Advanced Developer suite per accelarare lo sviluppo delle applicazioni e il rilascio di della tecnologia Trusted Profile Analyzer all'interno di OpenShift in grado di fornire informazioni su come è costituito il software sviluppato e rilasciato, come richiesto dalla direttiva NIS2 e il progetto Red Hat In-Vehicle Operating System, ovvero il sistema operativo per la guida autonoma il cui rilascio è previsto per il 2025: “Un intenso lavoro che coinvolge l'ecosistema di OEM e Car Player operativi in quel mercato specifico”, conclude Galli.

Rimani sempre aggiornato, seguici su Google News!

Seguici

Rimani sempre aggiornato, seguici su Google News!

Seguici

Barbara Torresani

Barbara Torresani